Kimi发布视觉思考模型k1:试题拍照给出答题思考全过程

2024-12-16 11:35

12 月 16 日消息,月之暗面 Kimi 今日发布视觉思考模型 k1。该模型基于强化学习技术打造,原生支持端到端图像理解和思维链技术,并将能力扩展到数学之外的更多基础科学领域。

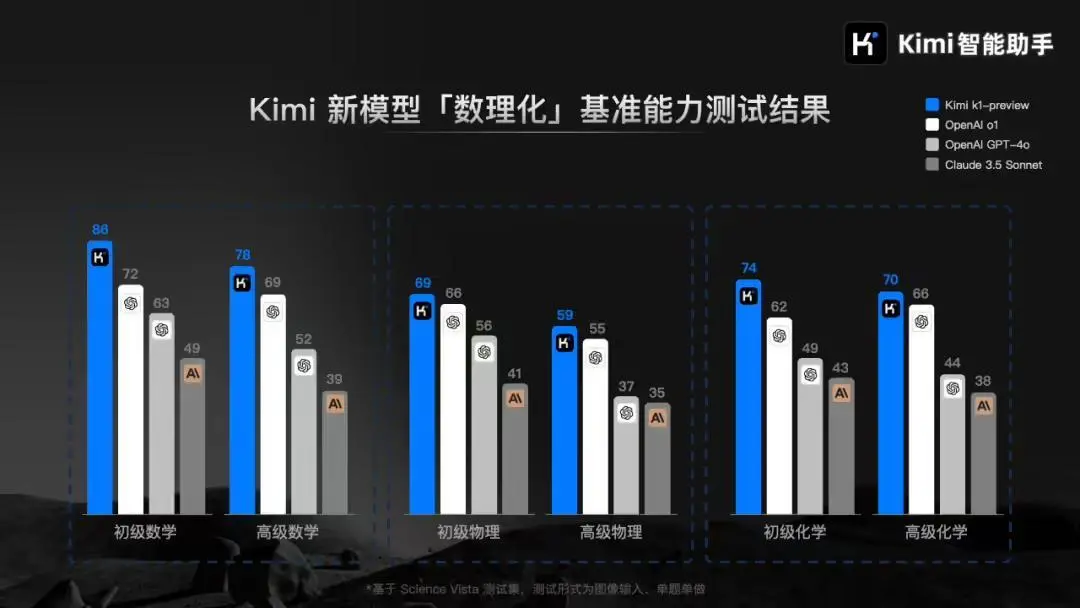

月之暗面官方表示,在数学、物理、化学等基础科学学科的基准能力测试中,初代 k1 模型的表现超过了 OpenAI o1、GPT-4o 以及 Claude 3.5 Sonnet。

IT之家从月之暗面官方获悉,Kimi 新模型发布即上线。k1 视觉思考模型已陆续上线最新版「Kimi 智能助手」的 Android 和 iPhone 手机 App 以及网页版 kimi.com。在最新版手机 App 或网页版 Kimi+ 页面找到「Kimi 视觉思考版」,即可拍照或传图体验。

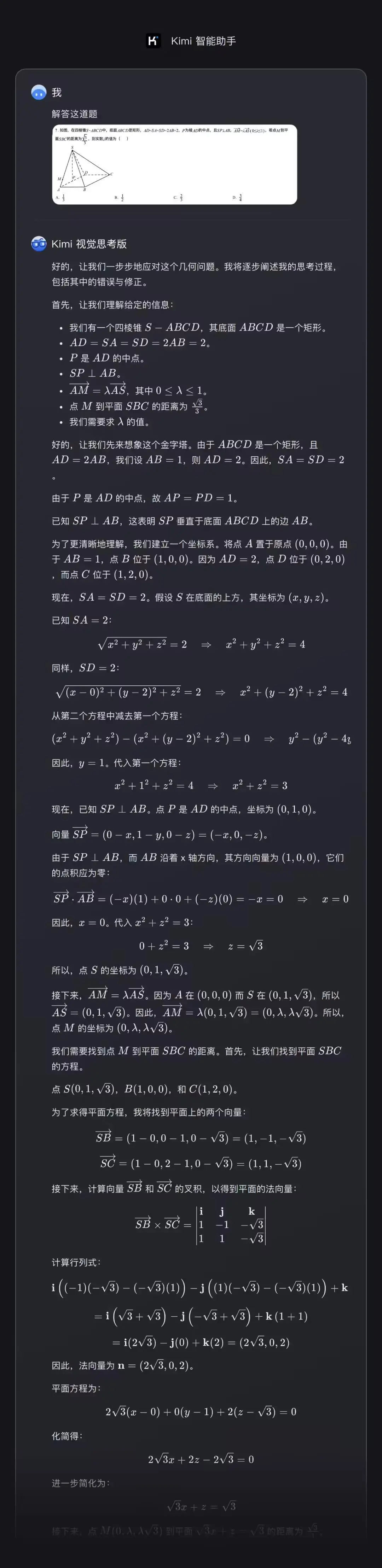

「Kimi 视觉思考版」会完整呈现推理思维链 CoT,让用户不只看到答题结果,也能完整看到模型思索答案的全过程。

从模型训练的角度看,k1 视觉思考模型的训练分为两个阶段,先通过预训练得到基础模型,再在基础模型上进行强化学习后训练。k1 的基础模型重点优化了字符识别能力,在 OCRBench 上得到 903 分的(state-of-the-art)结果,在 MathVista-testmini、MMMU-val 和 DocVQA 基准测试集上分数分别为 69.1、66.7 和 96.9。

月之暗面表示,k1 的强化学习后训练在数据质量和学习效率方面做了进一步优化,在强化学习的规模化(scaling)上取得了新的突破。

此外,科学的模型能力基准测试方案是大模型行业面临的重要挑战之一。由于市面上缺乏针对基础科学学科的图形测试集,Kimi 模型研发团队自主构建了一个标准化的测试集 Science Vista,涵盖不同难度的数理化图片题目,且从分布上与实际用户需求较为匹配。该测试集将开放给全行业,用户可申请在许可范围内使用。

在内部测试中,月之暗面也发现了一些 k1 视觉思考模型存在的局限性,例如在分布外(out-of-distribution)的泛化、在更复杂问题上的成功率、在更多噪声场景的准确率、多轮问答效果等方面,有很大提升空间。在一些场景和泛化能力上,k1 模型与 OpenAI 的 o1 系列模型相比仍有差距。

【来源:IT之家】

相关推荐

月之暗面回应“Cursor套壳Kimi K2.5”事件:属授权商业合作Kimi回应马斯克点赞:你的火箭也不错

Kimi总裁张予彤:以1%资源对标全球领先者,解码中国AI的效率优势

Kimi K2宣布更新:上下文长度扩展至256K,带来更快的API

Kimi多模态图片理解模型API发布,1M tokens定价12元起

消息称Kimi、豆包等AI应用本月广告投放超3亿元,开始“卷”投流

Kimi回应崩了:刚开始放量,没能接住大家的热情

阿里投资Kimi AI开发商月之暗面:8亿美元购入约36%股权

<返回首页

Copyright CmsTop.com

2026年04月14日 06:30:43